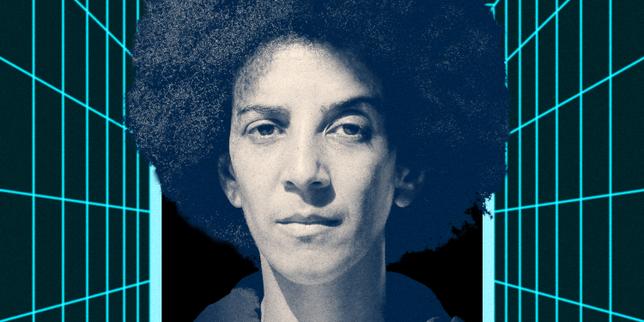

Timnit Gebru et la remise en cause des modèles d'IA à grande échelle

L'impact des grands modèles de langage

Timnit Gebru, ancienne codirectrice de l'équipe d'éthique de l'IA chez Google, a marqué un tournant dans l'industrie technologique avec ses recherches sur les risques des modèles massifs. Ses travaux se concentrent sur les dangers environnementaux et sociaux liés à l'entraînement de systèmes gourmands en données. Elle souligne que l'accumulation de données sans filtre reproduit et amplifie les préjugés présents sur le web.

La publication de son article sur les perroquets stochastiques a déclenché un débat mondial sur la transparence des géants du numérique. Gebru soutient que ces systèmes ne comprennent pas le sens des mots mais imitent simplement des séquences probables. Cette distinction est cruciale pour évaluer la fiabilité des réponses générées par les outils actuels.

- Les coûts énergétiques massifs de l'entraînement.

- La marginalisation des groupes sous-représentés dans les jeux de données.

- Le manque de mécanismes de contrôle sur les sorties des modèles.

La critique du concept de superintelligence

Gebru rejette fermement l'idéologie de la superintelligence artificielle souvent mise en avant par les dirigeants de la Silicon Valley. Selon elle, ce discours détourne l'attention des préjudices immédiats et tangibles causés par les technologies existantes. Elle voit dans cette quête d'une intelligence omnipotente une forme de dérive technologique qui ignore les besoins humains fondamentaux.

Cette vision remet en cause la trajectoire actuelle des investissements dans le secteur. Plutôt que de viser une autonomie totale des machines, elle plaide pour des systèmes plus petits, mieux documentés et spécialisés. La chercheuse insiste sur le fait que l'IA doit rester un outil sous contrôle humain plutôt qu'une entité autonome aux objectifs flous.

Indépendance et régulation du secteur

Depuis son départ de Google, Gebru a fondé le Distributed AI Research Institute (DAIR). Cette structure vise à produire des recherches indépendantes des financements des grandes entreprises technologiques. L'objectif est d'offrir une alternative aux modèles de développement dictés uniquement par la rentabilité et la croissance rapide.

Le travail de DAIR se focalise sur des cas d'usage concrets qui profitent aux communautés locales. Gebru encourage les développeurs à privilégier la qualité des données sur la quantité. Elle affirme que la régulation doit imposer une transparence totale sur les sources utilisées pour l'entraînement des algorithmes.

- Documentation exhaustive des jeux de données.

- Audit externe obligatoire pour les systèmes à haut risque.

- Responsabilité légale des entreprises sur les contenus générés.

Vers une technologie plus responsable

Le mouvement initié par Gebru influence désormais les politiques publiques en Europe et aux États-Unis. Les législateurs intègrent de plus en plus les notions d'audit algorithmique dans les nouveaux cadres réglementaires. Cette approche vise à protéger les droits des utilisateurs face à l'automatisation croissante des décisions sociales.

L'industrie commence à reconnaître que la performance brute ne suffit plus pour valider un produit. La sécurité et l'inclusivité deviennent des critères de compétitivité sur le marché mondial. Gebru continue de surveiller l'application réelle de ces principes dans les laboratoires de recherche privés.

Le prochain débat portera sur l'application concrète des lois sur le droit d'auteur face aux capacités de synthèse des modèles génératifs.

AI PDF Chat — Ask questions to your documents